Noticias

BSC y Biblioteca Nacional crean MarIA, una Inteligencia Artificial para mejorar las respuestas de otras IA en español

El Barcelona Supercomputing Center (BSC) y la Biblioteca Nacional han desarrollado un sistema de Inteligencia Artificial pensado para ayudar a que otros sistemas de Inteligencia Artificial puedan mejorar las respuestas que dan en español. Se trata de MarIA, que nace de un proyecto financiado gracias a los fondos del Plan de Tecnologías del Lenguaje del Ministerio de Asuntos Económicos y Agenda Digital. También de los de una iniciativa conjunta del BSC-CNS e IBM: el Future Computing Center.

MarIA, al que puede acceder de manera libre y gratuita cualquier desarrollador o empresa, cuenta con multitud de posibles aplicaciones. Entre otros, se puede utilizar en correctores o herramientas de predicción de lenguaje, así como en aplicaciones que realizan resúmenes de manera automática, bots de charla, sistemas de búsqueda inteligente y motores de traducción y creación automática de subtítulos.

Para entrenar al sistema se han utilizado ficheros de datos de la Biblioteca Nacional creados a partir del rastreo y archivo de la web de España, que dicha entidad conserva como patrimonio documental. El sistema es un conjunto de modelos de lenguaje entrenados para ser capaces de comprender la lengua española. Pero no solo su vocabulario, gramática y sintaxis, sino también los mecanismos que permiten expresar el significado de lo que se quiere decir en cada momento, así como escribir en español a un nivel avanzado. Estos modelos puede trabajar con interdependencias cortar y largas y pueden entender incluso conceptos abstractos y su contexto.

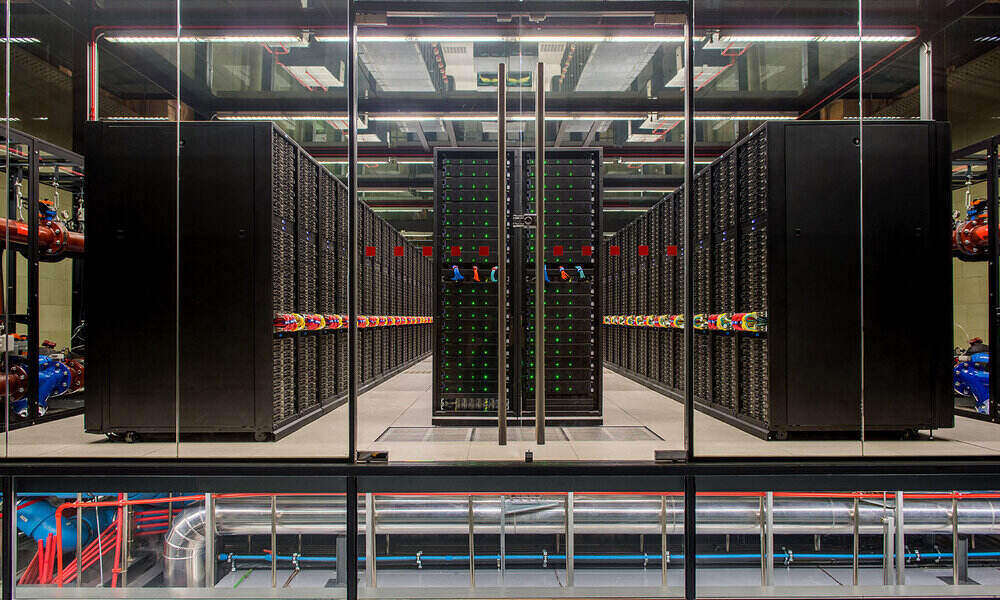

En la creación del corpus de la lengua utilizado por MarIA se han empleado 59 TB del archivo web que hay en la Biblioteca Nacional, que se procesaron para eliminar lo que no fuese texto formado de manera correcta en español. También los duplicados y las palabras y expresiones en otros idiomas. El cribado se realizó con la ayuda del superordenador MareNostrum, que arrojó como buenos más de 200 millones de documentos limpios, que ocupan 570 GB.

Tras generar este conjunto de documentos, los investigadores del BSC emplearon una tecnología de redes neuronales, a la que entrenaron para que aprendiese y fuese capaz de utilizar la lengua española. Como resultado se han liberado hasta ahora dos modelos, con 125 y 355 millones de parámetros respectivamente.

Pero el trabajo del equipo encargado del desarrollo de MarIA no ha terminado, puesto que el grupo de minería de textos del BSC trabaja ya en la ampliación el corpus conseguido, para lo que van a utilizar fuentes de archivos nuevos, con textos con particularidades distintas a los hallados en la web. Por ejemplo, publicaciones científicas. Además, el equipo tiene previsto generar modelos entrenados con textos de otros idiomas, como las lenguas autonómicas, portugués y el castellano hablado en países de América Latina.

-

OpiniónHace 6 días

OpiniónHace 6 días10 predicciones para los proveedores de servicios gestionados en 2025

-

NoticiasHace 6 días

NoticiasHace 6 díasAMD despedirá al 4% de su plantilla mientras se centra en IA y centros de datos

-

NoticiasHace 2 días

NoticiasHace 2 díasEl Capitan es el nuevo superordenador más potente y rápido del mundo

-

NoticiasHace 6 días

NoticiasHace 6 díasLa Comisión Europea multa a Meta con 798 millones por perjudicar a la competencia de Marketplace